動画生成AIの世界に、突如として革命が起きました。2026年4月7日のことです。動画生成AIの性能比較サイト「Artificial Analysis Video Arena」に、あるモデルが登場しました。

その名前は「HappyHorse-1.0」です。直訳すると「幸せな馬」という、少し変わった名前のAIモデルでした。

登場した当初、開発元の企業名は一切明かされていませんでした。

まさに「どこの馬の骨かわからない」状態だったのです。しかし、登場からわずか数日で状況は一変します。

テキストから動画を作るカテゴリ(T2V)でも、画像から動画を作るカテゴリ(I2V)でも、あっという間に世界1位を獲得したのです。世界中のAI研究者やクリエイターが騒然となりました。

そして3日後の2026年4月10日、ついに正体が明かされます。

開発元は、中国の巨大IT企業であるAlibaba Group(アリババグループ)でした。

名もなき馬が、動画生成AIのトップを走っていたByteDanceの「Seedance 2.0」や、Kuaishouの「Kling 3.0」を抜き去った瞬間です。

しかも、ブランド名を隠したブラインドテストでの完全勝利でした。

本記事では、この世界中を驚かせたHappyHorse-1.0について徹底的に解説します。どのようなAIモデルなのか。技術的にどこが優れているのか。既存のAIモデルと何が違うのか。

さらに、開発チームの驚くべき背景や、今後の公開スケジュールについても詳しく掘り下げます。動画制作に関わるクリエイターや、AIビジネスに興味がある方は必見の内容です。

みなさんは、AIが音声と動画を同時に作り出す未来を想像したことがありますか。HappyHorseは、その未来をすでに実現しています。

それでは、世界を獲ったAI動画生成モデルの正体に迫っていきましょう。

HappyHorse-1.0とは?基本プロフィールと全体像

まずは、HappyHorse-1.0の全体像を把握しましょう。結論から言うと、HappyHorseは「動画と音声を同時に作り出すことができる超高性能なAI」です。

Alibaba傘下のAI研究開発ユニットが総力を挙げて開発しました。テキストの指示や1枚の画像から、高品質な動画と音声をワンステップで生成します。

ここでは、HappyHorseの基本的なプロフィールを整理します。

圧倒的なスペックを持つAIモデル

HappyHorseの基本スペックは、以下の表の通りです。非常に高い性能を持っていることがわかります。

| 項目 | 内容 |

|---|---|

| 開発元 | Alibaba Group(ATH AI Innovation Unit/Taotian Future Life Lab) |

| プロジェクトリーダー | Zhang Di(張迪)氏 |

| パラメータ数 | 150億(15B) |

| アーキテクチャ | 40層 Unified Single-Stream Transformer |

| 生成形式 | Text-to-Video / Image-to-Video(音声あり・なし両対応) |

| 最大解像度 | 1080p(フルハイビジョン) |

| 推論速度 | H100という計算機1枚で1080p動画を約38秒で生成 |

| 対応言語(リップシンク) | 中国語・英語・日本語・韓国語・ドイツ語・フランス語(+広東語) |

| 公開予定 | 2026年4月30日 API公開予定/その後オープンソース化の見通し |

この表の中で、特に注目すべきポイントが3つあります。

1つ目は、150億というパラメータ数です。パラメータとは、AIの「脳のシワ」のようなものです。この数が大きいほど、複雑な処理が可能になります。150億という数字は、動画生成AIとしては非常に大規模です。

2つ目は、最大解像度が1080pであることです。1080pは、YouTubeなどの一般的な動画サイトで「高画質」とされる基準です。商用利用にも十分耐えられる画質を誇ります。

3つ目は、日本語を含む7つの言語に対応している点です。しかも、動画の口の動きと音声がぴったり合う「リップシンク」機能を備えています。

マルチモーダルAIとしての進化

HappyHorseは「マルチモーダルAI」と呼ばれます。マルチモーダルとは、テキスト、画像、音声、動画など、複数の種類の情報を同時に扱える技術のことです。

従来のAIは「テキストから文章を作る」「画像から画像を加工する」といった単一の処理が得意でした。しかし、HappyHorseは異なります。

テキストを入力すると、それに合った動画と音声を同時に出力します。画像を入力すれば、その画像が動き出し、適切な効果音やセリフが付与されます。

例えば、「海辺を走る犬」というテキストを入力したとしましょう。HappyHorseは、犬が走る映像だけでなく、波の音や犬の足音まで一緒に生成してくれます。

動画制作の手間を大幅に削減できる画期的な仕組みと言えるでしょう。

開発の舞台はAlibabaの最先端ラボ

HappyHorseを開発したのは、Alibabaの「Taotian Future Life Lab(淘天未来生活実験室)」という組織です。

この組織は、Alibabaグループの中でも特に未来の技術を研究する最先端のラボです。優秀な研究者と、膨大な計算資源が集まっています。

Alibabaは、これまでもAI技術に多額の投資を行ってきました。HappyHorseは、その投資が実を結んだ最高傑作と言っても過言ではありません。

開発チームのトップを務めるのは、Zhang Di(張迪)氏です。彼の存在が、HappyHorseの成功に大きく貢献しています。Zhang氏の経歴については、後ほど詳しく解説します。

匿名デビューの衝撃とAlibabaの高度な戦略

HappyHorseの登場で最も話題になったのは、その「デビューの仕方」です。結論から述べると、Alibabaは意図的に名前を隠してモデルを公開する「ステルス戦術」を採用しました。

なぜ、世界的企業であるAlibabaが、わざわざ自社の名前を隠したのでしょうか。そこには、非常に計算された高度な戦略がありました。

業界を翻弄した「名もなき馬」

2026年4月7日、HappyHorseは「Artificial Analysis Video Arena」という評価サイトに突如として現れました。

このサイトは、2つのAIモデルが作った動画を並べて表示します。そして、ユーザーがどちらの動画が優れているかを投票する仕組みです。モデルの名前は伏せられた状態で投票が行われます。

HappyHorseは、このブラインドテストで驚異的な強さを発揮しました。瞬く間に強豪モデルを打ち破り、ランキングのトップに躍り出たのです。

世界中のAIウォッチャーは騒然としました。「この圧倒的な性能を持つモデルは誰が作ったのか」「OpenAIの秘密兵器ではないか」「いや、Googleの未発表モデルかもしれない」。

SNSや技術フォーラムでは、連日激しい議論が交わされました。Bloombergの報道によると、投資家たちもこの謎のモデルの正体を探るために奔走したそうです。

意図的なステルス戦術の狙い

Alibabaが正体を明かしたのは、ランキング1位が確実になった3日後の4月10日でした。この「匿名デビュー」には、3つの明確な狙いがあったと考えられます。

1つ目は、純粋な実力による評価を獲得することです。

もし最初から「Alibabaの新モデル」と発表していれば、企業のブランドイメージや先入観が評価に影響したかもしれません。名前を隠すことで、先入観のない純粋な実力勝負に持ち込んだのです。

2つ目は、話題性の最大化です。

「謎の最強モデルが現れた」というミステリー要素は、メディアや専門家の関心を強く惹きつけました。結果として、普通に発表するよりも何倍もの宣伝効果を生み出しました。

3つ目は、競合他社への強烈なプレッシャーです。

どこの企業が作ったかわからないモデルに、自社の主力製品が負ける。これは競合他社にとって非常に屈辱的な出来事です。Alibabaは、技術力の違いを最も残酷な形で証明してみせたのです。

完璧だった公開のタイミング

さらに、HappyHorseが登場したタイミングも絶妙でした。

2026年4月上旬は、動画生成AI市場が大きな転換点を迎えていた時期です。先行していたOpenAIの動画生成AI「Sora」が、サービスの終了を発表していました。

また、ByteDanceの「Seedance 2.0」は、ハリウッドの映画会社との著作権紛争に巻き込まれていました。その結果、サービスの展開を一時停止せざるを得ない状況に追い込まれていたのです。

強大なライバルたちが次々と「退場」していく空白のタイミング。そこに、圧倒的な実力を持つHappyHorseが舞い降りたわけです。

Alibabaにとって、これ以上ない最高のお披露目の舞台が整っていたと言えるでしょう。偶然の産物ではなく、市場の動向を正確に読み切った見事な戦略でした。

圧倒的な技術力:統合単一ストリーム構造の秘密

HappyHorseが世界1位を獲得できた最大の理由は、その根幹にある技術アーキテクチャにあります。結論を言うと、「ワンパスで音声と動画を同時に作る」という画期的な仕組みを採用しているからです。

ここでは、HappyHorseの技術的な凄さを、専門用語をできるだけ使わずにわかりやすく解説します。

従来の動画生成AIが抱えていた弱点

HappyHorseの凄さを理解するために、まずは従来の動画生成AIの仕組みを知る必要があります。

これまでの主要な動画生成モデルは、「多段パイプライン」という方式を採用していました。これは、複数の工程を順番にこなしていくリレー競争のような仕組みです。

具体的には、以下のような3つのステップを踏んでいました。

- まず、無音の動画だけを生成する

- 次に、その動画に合った音声を別のAIで生成して付加する

- 最後に、登場人物の口の動きと音声を無理やり合わせる(リップシンク)

この方式には、大きな問題が2つありました。

1つは「エラーの蓄積」です。工程が分かれているため、最初の動画生成で少しでも不自然な部分があると、次の音声付加でさらに不自然さが際立ってしまいます。

もう1つは「遅延(レイテンシ)」です。3つの工程を順番に処理するため、どうしても生成に時間がかかってしまうのです。

ワンパスで同時生成する魔法の構造

HappyHorseは、この従来のリレー競争方式を根本から覆しました。すべての作業を「1回の処理(ワンパス)」で同時に行ってしまうのです。

これを実現しているのが、「Unified Single-Stream Transformer(統合単一ストリーム構造)」と呼ばれる技術です。

少し難しい言葉ですが、要するに「テキスト、画像、動画、音声のすべての情報を、1つの巨大な処理ラインで一気に処理する仕組み」だと考えてください。

HappyHorseは40層という深い処理の層を持っています。この40層の中で、映像のピクセル情報と音声の波形情報を同時に計算し、互いに影響を与え合いながら完成品を作り上げます。

公式の情報によれば、処理を複雑にする「cross-attention(交差注意)モジュール」という部品を一切使っていません。非常にシンプルで洗練された一筆書きの計算処理で、映像と音声を生み出しています。

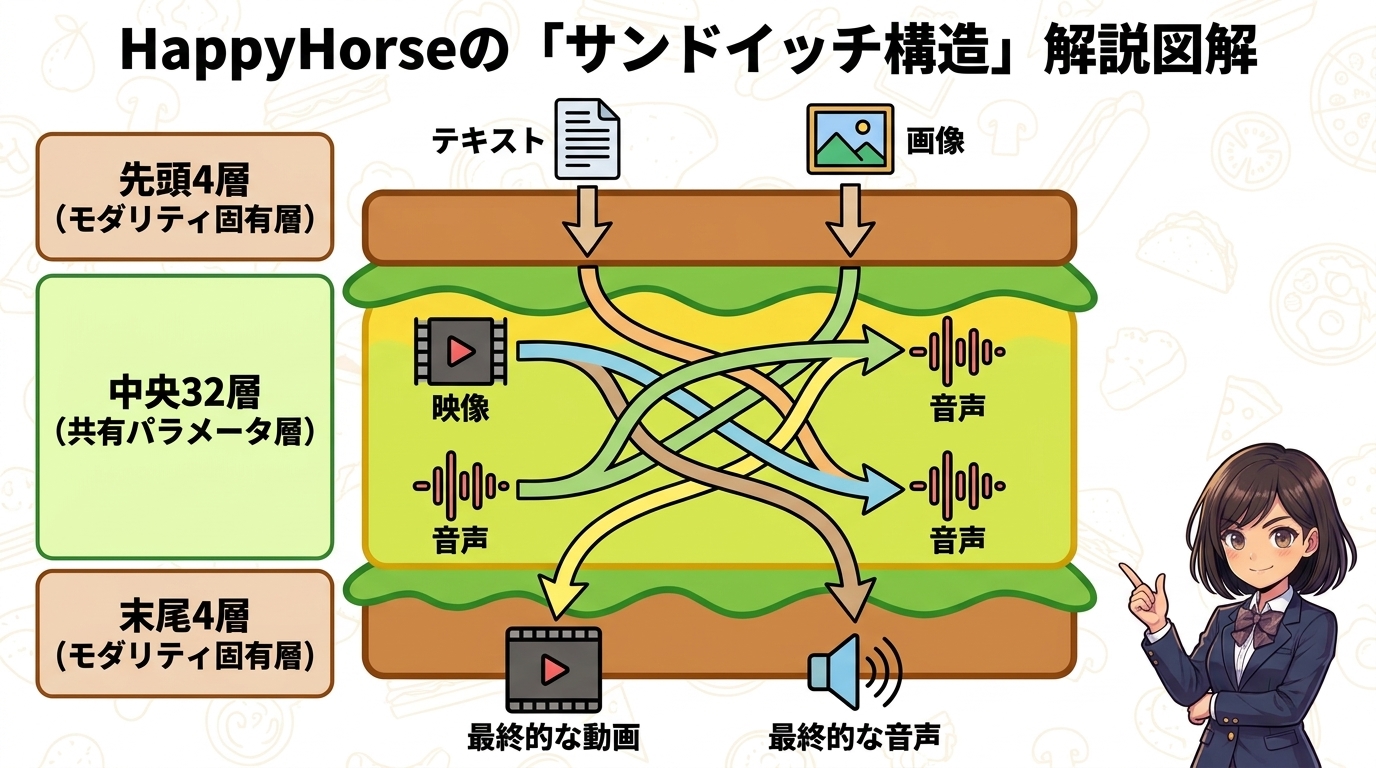

独自開発の「サンドイッチ設計」

さらに面白いのが、HappyHorseのアーキテクチャが「サンドイッチ」のような構造になっている点です。

全40層の処理レイヤーのうち、構成は以下のようになっています。

- 先頭の4層:テキストや画像など、入力された情報の種類(モダリティ)に特化した処理を行う

- 中央の32層:すべての情報が混ざり合い、共通のパラメータを使って高密度な計算を行う

- 末尾の4層:再び情報の種類ごとに分かれ、最終的な動画と音声を出力する

パン(先頭4層)とパン(末尾4層)の間に、分厚い具材(中央32層)が挟まっているようなイメージです。

このサンドイッチ設計のメリットは何でしょうか。

それは、テキストや音声が持つ「それぞれの個性」を保ったまま、AIの脳内で深く結びつけることができる点です。

例えば、「悲しそうに泣く女性」というテキストを入力したとします。中央の32層で、女性の悲しい表情(映像)と、すすり泣く声(音声)が密接に連動して計算されます。

その結果、映像と音声に一切のズレがない、極めて自然で感情豊かな動画が完成するのです。これは、従来の多段パイプライン方式では絶対に不可能な表現力です。

ネイティブなリップシンクと多言語対応がもたらす革命

HappyHorseの技術的な強みの中でも、特にクリエイターから絶賛されている機能があります。それが「ネイティブなリップシンク」と「圧倒的な多言語対応」です。

結論から言えば、HappyHorseを使えば、世界中の言語で自然に話すキャラクター動画を、一瞬で作ることができます。

「あとから合わせる」からの脱却

リップシンクとは、映像に登場する人物の口の動きを、発声しているセリフに合わせる技術のことです。

先ほども触れましたが、従来のAIモデルは「あとから口の動きを合わせる」というアプローチをとっていました。動画を作った後に、音声の波形に合わせて口の周辺のピクセルだけを無理やり変形させていたのです。

この方法だと、どうしても不自然さが出ます。口の端が歪んだり、言葉の途中で口の形がおかしくなったりすることが頻繁にありました。

しかし、HappyHorseのリップシンクは「ネイティブ」です。つまり、動画と音声を同時に生成する過程で、最初から口の動きが計算されているのです。

「あ」という音声を生成する瞬間、AIは同時に「あ」と発音するときの自然な口の開き方、あごの筋肉の動き、さらには目元の表情までを連動して描き出します。

そのため、人間が実際に話しているのと区別がつかないほど、極めて滑らかで自然なリップシンクが実現できるのです。

驚異の7言語対応

HappyHorseのもう一つの大きな武器が、対応言語の多さです。公式発表によると、以下の7つの言語に対応しています。

- 中国語(北京語)

- 中国語(広東語)

- 英語

- 日本語

- 韓国語

- ドイツ語

- フランス語

一般的な動画生成AIは、英語と開発国の言語(中国語など)の1〜2言語しか対応していないことがほとんどです。他の言語を使いたい場合は、後から別のソフトを使って吹き替えを行うしかありませんでした。

しかし、HappyHorseは最初から7つの言語を深く理解しています。

例えば、同じキャラクターの画像を使って、「日本語で挨拶する動画」と「フランス語で挨拶する動画」を作ったとしましょう。

HappyHorseは、単に音声を切り替えるだけではありません。日本語を話すときの特有の口の動かし方と、フランス語を話すときの唇の突き出し方の違いまで、正確に描き分けるのです。

日本のコンテンツ産業への影響

この多言語対応、特に「日本語」が明示的にサポートされていることは、日本のクリエイターにとって朗報です。

これまで、海外製のAIモデルを使って日本向けのコンテンツを作る際、「日本語のセリフがうまく合わない」という悩みが常にありました。英語の口の動きに日本語を乗せるため、違和感が拭えなかったのです。

HappyHorseを使えば、この問題が完全に解消されます。

アニメのキャラクターに自然な日本語のセリフを喋らせる。実写風のAIタレントに、流暢な日本語で商品紹介をさせる。こうした作業が、テキストを打ち込むだけで完了する時代が到来しました。

みなさんも、言葉の壁を越えて世界中にコンテンツを発信できる可能性を感じませんか。HappyHorseは、グローバルな動画制作のハードルを劇的に下げるツールとなるでしょう。

驚異の推論速度とハードウェア要件の詳細

どんなに高品質な動画を作れるAIでも、生成に何時間もかかるようでは実用的ではありません。結論として、HappyHorseは生成スピードの面でも既存のモデルを大きく引き離しています。

ここでは、HappyHorseの「推論速度(動画を作り出すスピード)」と、それを支えるハードウェア環境について詳しく見ていきます。

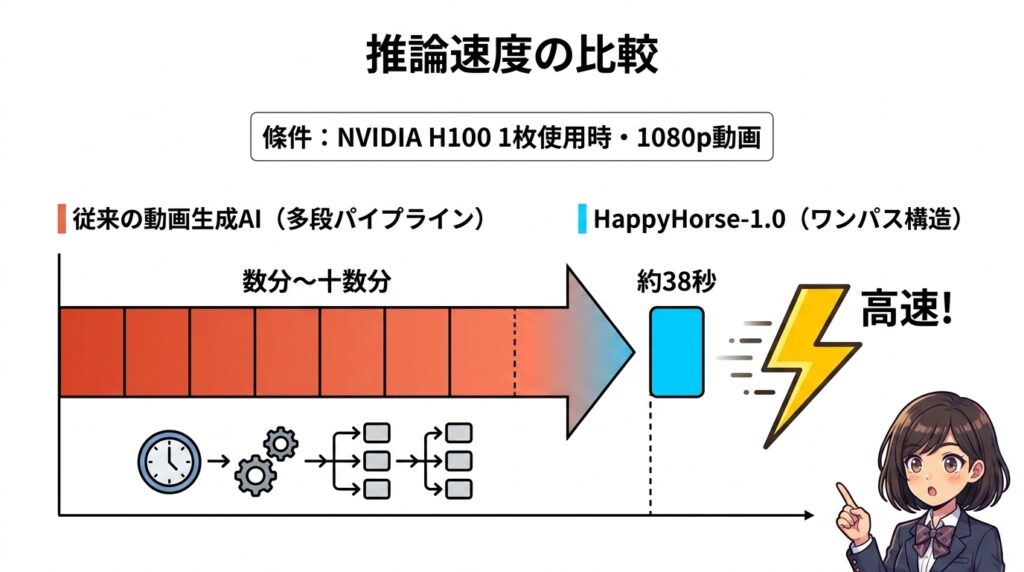

H100 1枚で38秒という破壊的スピード

Alibabaの公式発表によれば、HappyHorseの推論速度は驚異的です。

最新のAI向け半導体である「NVIDIA H100」を1枚使用した場合、1080p(フルハイビジョン)の高画質動画を、わずか約38秒で生成できるとされています。

この38秒という数字がどれほど凄いのか、比較してみましょう。

従来の高品質な動画生成AIでは、同じ1080pの動画を作るのに、数分から十数分かかるのが当たり前でした。短いプロモーションビデオを作るだけでも、AIの処理待ちで多大な時間を浪費していたのです。

HappyHorseは、その待ち時間を1分未満に短縮しました。

さらに、解像度を落としたテスト用の動画であれば、より高速に生成できます。例えば、256pの解像度で5秒間の短いクリップを作る場合、なんと約2秒で出力が完了します。

「プロンプト(指示文)を入力してエンターキーを押したら、すぐに動画が動き出す」。そんなリアルタイムに近い感覚で動画制作ができるのです。

ワンパス構造がもたらす速度革命

なぜ、これほどの高速化が可能になったのでしょうか。その秘密は、やはり「ワンパス構造」にあります。

先ほど解説したように、従来のAIは動画と音声を別々に作り、後から合成していました。各工程の間でデータの受け渡しが発生し、それが大きな時間のロスになっていたのです。

HappyHorseは、統合単一ストリーム構造によって、無駄なデータのやり取りを完全に排除しました。AIの脳内で一度だけ計算を走らせれば、完成品が一瞬で出てくる仕組みです。

この構造的な優位性が、圧倒的なスピードを生み出しています。

商用ワークフローにおける価値

推論速度が速いことは、単に「イライラしない」という以上の価値を持ちます。ビジネスの現場では、スピードはそのままコスト削減と品質向上に直結します。

動画制作の現場では、「イテレーション(試行錯誤)」が欠かせません。

「このキャラクターの動きを少し変えたい」「背景の照明をもう少し暗くしたい」。クリエイターは何度もAIに指示を出し直し、理想の映像を追求します。

1回の生成に10分かかるAIの場合、1時間に試せる回数はたったの6回です。

しかし、HappyHorseのように38秒で生成できるAIなら、1時間に約90回も試行錯誤を繰り返すことができます。

クリエイターは妥協することなく、最高品質の動画を追求できるようになります。制作スピードが劇的に上がり、クライアントへの納品サイクルも大幅に短縮されるでしょう。

HappyHorseのスピードは、動画制作のワークフローそのものを根本から変革する力を持っているのです。

ベンチマーク結果の徹底解剖:圧倒的なスコアの理由

HappyHorseが「世界1位」と称される根拠はどこにあるのでしょうか。結論から言うと、世界で最も信頼されているブラインド評価サイトにおいて、史上最大の得点差で首位を獲得したからです。

ここでは、そのベンチマーク(性能評価)の具体的な結果と、スコアが意味する価値について深く掘り下げます。

Artificial Analysis Video Arenaの仕組み

HappyHorseの性能を証明したのは、「Artificial Analysis Video Arena(アーティフィシャル・アナリシス・ビデオ・アリーナ)」というサイトです。

このサイトは、AIモデルの性能を人間が直接評価するプラットフォームとして、業界内で最も権威があります。

評価の仕組みは非常にシンプルかつ公平です。

- システムが同じプロンプト(指示文)を、2つの異なるAIモデルに送信します。

- 2つのAIがそれぞれ動画を生成し、画面に並べて表示されます。

- 評価する人間のユーザーには、どちらの動画がどのAIで作られたかは一切知らされません。

- ユーザーは、画質、動きの自然さ、指示への忠実さなどを基準に、より優れていると思う動画に投票します。

この投票結果をもとに、「Elo(イロ)レーティング」という計算式でスコアが算出されます。チェスや将棋の強さを表すのと同じ計算方法です。

2026年4月時点の驚異的なEloスコア

HappyHorseは、この過酷なアリーナで驚くべき成績を残しました。2026年4月時点の各カテゴリのスコアを見てみましょう。

| カテゴリ | HappyHorse-1.0の成績 | 2位との差 |

|---|---|---|

| Text-to-Video(音声なし) | 1,389 Elo(1位) | Seedance 2.0 に約115ポイントの差 |

| Text-to-Video(音声あり) | 1位 | Seedance 2.0 に11ポイントの差で接戦 |

| Image-to-Video(音声なし) | 1,415 Elo(1位) | Seedance 2.0 に57ポイントの差 |

| Image-to-Video(音声あり) | 2位 | Seedance 2.0 とわずか1点差 |

この結果から、HappyHorseがすべての主要カテゴリで1位または2位という、圧倒的な強さを誇っていることがわかります。

史上最大「1,415 Elo」の衝撃

特に注目すべきは、Image-to-Video(画像から動画を生成するカテゴリ・音声なし)で叩き出した「1,415 Elo」というスコアです。

このカテゴリで2位につけているByteDanceのSeedance 2.0との差は、なんと57ポイントにも及びます。

Eloレーティングにおいて、50ポイント以上の差は「明確な実力差がある」ことを意味します。専門家によれば、この57ポイント差は、同アリーナの歴史上最大のポイント差だと言われています。

画像から動画を作る技術は、広告制作やアニメーション制作において最も需要が高い機能です。元の画像の魅力を損なわず、いかに自然な動きを加えるかが問われます。

HappyHorseは、この最も重要なカテゴリで他を寄せ付けない圧倒的な強さを見せつけました。視覚的な忠実度や物理法則の理解において、AIの限界を一段階引き上げたと言えるでしょう。

みなさんも、一枚の静止画が魔法のように動き出す瞬間を見たら、きっとその技術力に驚かされるはずです。

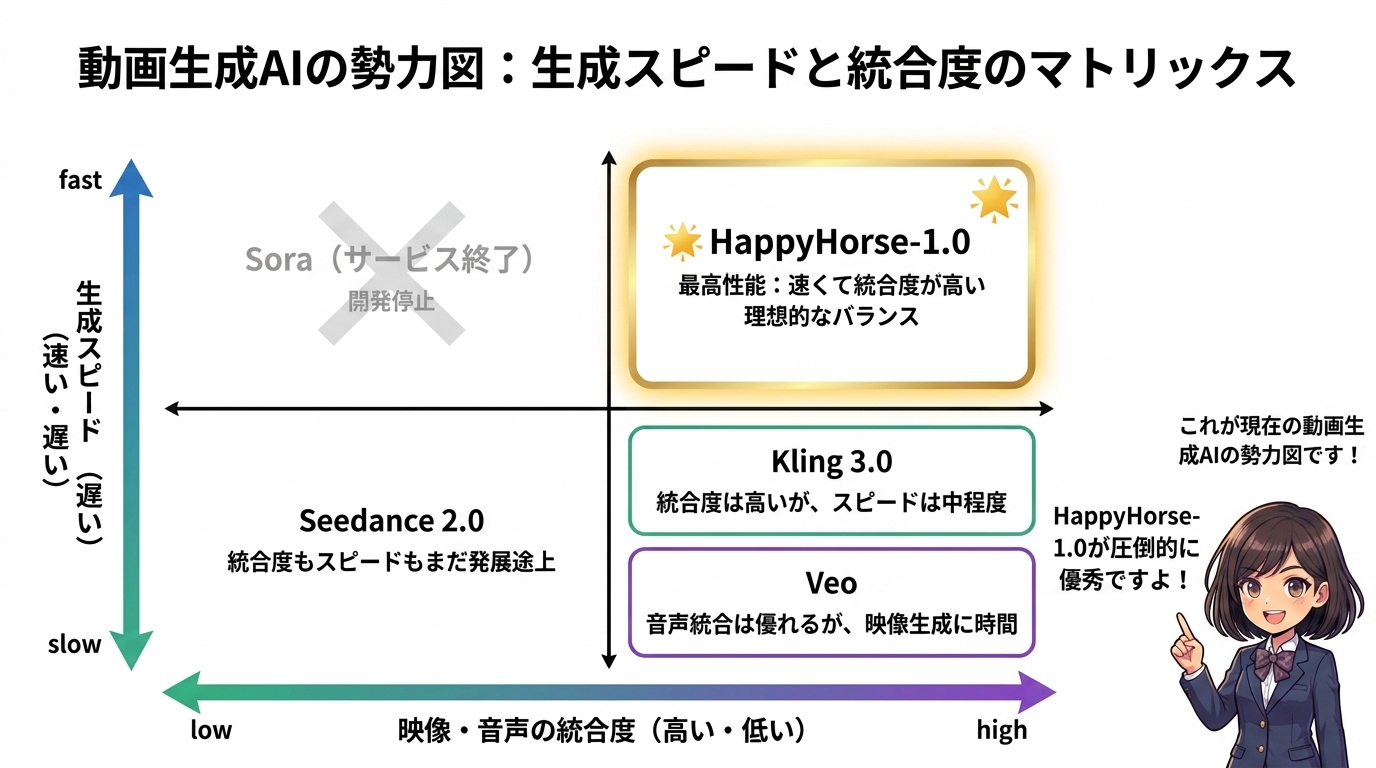

競合モデルとの比較:動画生成AI市場の覇権争い

HappyHorseの凄さをより深く理解するために、ライバルとなる競合モデルとの比較を行ってみましょう。結論として、HappyHorseは画質、速度、音声統合のすべての面で、現在のトップ層を一歩リードしています。

2026年4月現在、動画生成AIのトップ層を形成しているのは、HappyHorseを含めた以下の4つのモデルです。

ByteDance「Seedance 2.0」との比較

Seedance 2.0は、TikTokを運営するByteDanceが開発した強力なモデルです。HappyHorseが登場するまで、長らく王座に君臨していました。

Seedance 2.0の強みは、エンターテインメントに特化した派手な演出や、ダイナミックなカメラワークです。特に音声ありのテキスト生成カテゴリでは、HappyHorseとほぼ互角の戦いを繰り広げています(11ポイント差)。

しかし、弱点もあります。著作権問題を抱えていることと、音声の統合が多段パイプライン方式である点です。

HappyHorseは、ワンパス構造による完璧なリップシンクと、クリーンな開発背景によって、Seedance 2.0の弱点を見事に突いています。特に静止画からの動画生成(I2V)では、HappyHorseが完全に圧倒しています。

Kuaishou「Kling 3.0」との比較

Kling 3.0は、中国のショート動画プラットフォームKuaishou(快手)が開発したモデルです。リアルな物理シミュレーションに定評があります。

Kling 3.0の最上位モデル「Omni Pro」は、Image-to-Videoのスコアが1,299 Eloです。

HappyHorseの1,415 Eloと比較すると、実に116点もの大差がついています。ブラインドテストのデータ分析によれば、HappyHorseは「視覚的忠実度」と「プロンプトへの追従性」でKling 3.0を大きく上回っていることが分かっています。

複雑な指示を出したとき、Kling 3.0は時折指示を無視したり、映像が崩れたりすることがありますが、HappyHorseは指示を正確に守り抜く安定感があります。

Google「Veo」との比較

Googleの動画生成AI「Veo」は、映画レベルの高画質と、長尺動画の生成に強みを持っています。

Veoは非常に優秀なモデルですが、推論速度の面でHappyHorseに遅れをとっています。また、多言語のリップシンク機能においても、HappyHorseの7言語対応には及びません。

スピードと多機能性を求めるクリエイターにとって、HappyHorseはVeoよりも使い勝手の良い選択肢となっています。

王座の空白を埋めたHappyHorse

忘れてはならないのが、かつての王者であるOpenAIの「Sora」の存在です。Soraは圧倒的なクオリティで世界に衝撃を与えましたが、計算コストの問題や安全性への懸念から、サービス終了を余儀なくされました。

Soraの退場と、Seedance 2.0の著作権問題。この2つの出来事によって生じた「王座の空白」に、完璧なタイミングで滑り込んだのがHappyHorseです。

単に技術力が高いだけでなく、ライバルたちが躓いている隙を突く市場投入の巧みさ。これこそが、HappyHorseが現在の覇権を握っている最大の理由なのです。

開発チームの裏側:Zhang Di氏の引き抜きと組織再編

AIモデルの性能は、それを開発する「人間」の能力に大きく依存します。HappyHorseの成功の裏には、まるで映画のようなドラマチックな人材獲得劇がありました。

結論から言うと、HappyHorseはライバル企業から引き抜かれた天才エンジニアの手によって、わずか数ヶ月で作り上げられたのです。

キーパーソン:Zhang Di(張迪)氏の素顔

HappyHorseプロジェクトを率いているのは、Zhang Di(張迪)氏という人物です。彼こそが、この物語の最大のキーパーソンです。

Zhang氏は、もともとライバル企業であるKuaishou(快手)で副社長(VP)を務めていました。そして驚くべきことに、先ほど比較に挙げた強力なAIモデル「Kling AI」の技術アーキテクト(基本設計者)だったのです。

つまり、Zhang氏は「Klingの生みの親」でした。

彼は2025年末にKuaishouを突如として退社し、Alibabaへと移籍します。Zhang氏にとって、Alibabaは5年ぶりに復帰する古巣でした。

SCMP(サウスチャイナ・モーニング・ポスト)の報道によれば、Zhang氏は2025年11月にAlibabaに合流して以降、猛烈なスピードでHappyHorseプロジェクトを推進しました。

自分がかつて築き上げた最強のプラットフォーム(Kling)と直接競合し、しかもそれをブラインドテストで抜き去るモデルを、わずか数ヶ月のうちに完成させてしまったのです。

この事実だけでも、Zhang氏の並外れた技術力と執念が伝わってきます。

開発拠点:Taotian Future Life Lab

Zhang氏が率いるチームの拠点は、Alibabaの「Taotian Future Life Lab(淘天未来生活実験室)」です。

このラボは、単なる研究施設ではありません。Alibabaの主力事業であるeコマース(ネット通販)のコアとなるアルゴリズムを開発している、中国最大級のAI応用現場です。

トップクラスのAI人材と、世界最大規模の計算資源(サーバーやGPU)が惜しみなく投入されています。

公式の発表では、開発元は「ATH AI Innovation Unit(Alibaba Token Hub)」とされています。これは、Alibabaが次世代のAIビジネスを創出するために新設した特命チームです。

豊富な資金力、最強の計算環境、そして天才的なリーダー。HappyHorseが世界1位を獲るための条件は、最初から完璧に揃っていたのです。

Eddie Wu CEOの「AI全振り」戦略

Zhang氏の引き抜きとHappyHorseの迅速な開発は、Alibabaの経営トップの強い意志によって裏付けられています。

AlibabaのEddie Wu(呉泳銘)CEOは、近月にかけて「全事業のプライオリティをAIの開発に置く」という大胆な方針転換を進めてきました。究極の目標として、AGI(汎用人工知能)の実現を掲げています。

Wu CEOは、AIを収益化するための事業構造再編を断行しました。自らが議長を務める4人の技術委員会を新設し、意思決定のスピードを劇的に引き上げました。

HappyHorseは、このAlibabaの「AI全振り」戦略が世に送り出した、最初の巨大な成功例(ショーケース)なのです。

会社を挙げてAIに賭ける本気度が、HappyHorseという圧倒的なプロダクトを生み出しました。

Alibaba社内の並行開発:Wanシリーズとの関係性

ここで、AI業界に詳しい読者なら一つの疑問が浮かぶはずです。

「Alibabaには、すでに『Wan(万相)』という有名な動画生成モデルがあるのではないか?」

その通りです。Alibabaは今月初め、旗艦モデルであるWanシリーズの最新版「Wan 2.7」をリリースしたばかりでした。それなのに、なぜ全く別系統のHappyHorseが突然出てきたのでしょうか。

結論から言うと、Alibabaは社内で複数のチームを競わせる「並列開発」を行っているのです。

Wan系統とHappyHorse系統の違い

現在のAlibabaのAI動画開発体制は、大きく2つの系統に分かれています。

1つ目は、Tongyi(通義)研究ラボ発のモデルです。これが既存の旗艦モデルである「Wan 2.x系統」です。長年の研究実績があり、Alibabaの公式な顔として展開されてきました。

2つ目は、Future Life Lab/ATH発のモデルです。これが今回登場した新興の挑戦者「HappyHorse」です。Zhang Di氏が率いる、より尖った技術を追求する特命チームです。

コミュニティの一部では、「HappyHorseは、実はWan 2.7の名前を変えただけ(リブランド)ではないか」という推測も飛び交いました。

しかし、技術的なアーキテクチャ(Wanは拡散モデルベースの要素が強いのに対し、HappyHorseは完全な単一Transformer)や、開発チームの所属が明確に異なることから、この2つは「完全に別物」と考えるのが妥当です。

なぜ社内で競合させるのか?

同じ会社の中で、似たような目的のAIモデルを別々のチームに作らせる。一見すると無駄が多いように思えます。

しかし、これこそがEddie Wu CEOの狙いです。

AIの技術進化はあまりにも速く、一つの技術アプローチに固執することは企業にとって命取りになります。もしWanシリーズの技術が行き詰まった場合、会社全体が立ち遅れてしまいます。

そこで、異なるアプローチを持つ複数のチームに潤沢な予算を与え、社内で激しく競争させるのです。これをビジネス用語で「カニバリゼーション(共食い)を恐れない戦略」と呼びます。

結果として、新参者のHappyHorseが既存のWanシリーズを凌駕する性能を叩き出しました。Alibabaにとっては、どちらが勝っても自社の技術力が上がるため、痛手はありません。

むしろ、社内競争によって世界最高峰のモデルが生まれたことは、この戦略が大成功だったことを証明しています。

読者のみなさんの会社でも、あえて別々のチームに同じ課題を与えて競わせることはありますか。巨大IT企業の貪欲な開発姿勢には、学ぶべき点が多くあります。

制作現場での具体的な活用法とビジネスへの影響

さて、ここまでHappyHorseの技術力や背景について解説してきました。では、この最強のAIモデルは、実際のビジネスや動画制作の現場をどう変えるのでしょうか。

結論として、アニメーション制作、広告映像、YouTubeコンテンツなどの分野で、圧倒的なコスト削減と表現の拡張をもたらします。

ここでは、クリエイターや制作サイドから見たHappyHorseの具体的な活用法とメリットを3つ紹介します。

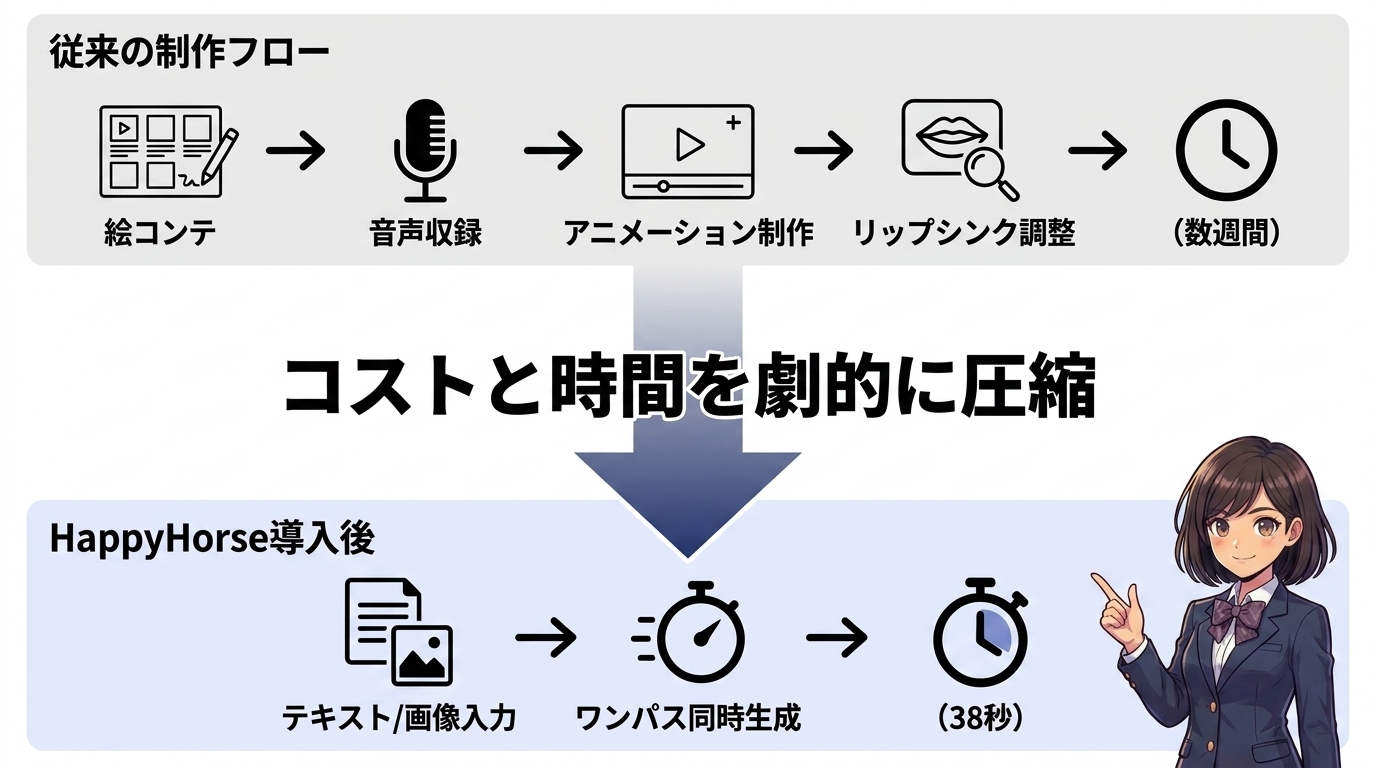

1. 絵コンテから動画確認までのサイクルを極限圧縮

映像制作の初期段階では、「絵コンテ(ストーリーボード)」を作成し、それを元に簡単なテスト映像(Vコンテやプレビズ)を作って動きを確認します。

従来、この作業には多くのアニメーターやCGクリエイターの手が必要で、数週間から数ヶ月の時間がかかっていました。

HappyHorseを使えば、この工程が劇的に変わります。

手描きのラフな絵コンテを画像として読み込ませ、テキストで「カメラが右から左へパンする。キャラクターが歩き出す」と指示するだけです。

H100 1枚で38秒という高速処理により、その場で高画質なテスト映像が完成します。さらに、仮のセリフ(音声)まで同時に生成されるため、タイミングや尺の確認が一度で終わります。

監督やクライアントはその場で映像を確認し、すぐに修正指示を出すことができます。制作の初期サイクルが、数週間から数時間に圧縮されるのです。

2. 「リップシンクずれ」からの解放

キャラクターが喋る短尺コンテンツ(TikTokやYouTube Shortsの動画など)を制作する際、最大のボトルネックだったのが「音声と口の動きを合わせる作業」です。

「絵はすごく綺麗に生成できたのに、口の動きが不自然でボツになった」という経験を持つクリエイターは多いはずです。

HappyHorseは、音声込みのワンパス生成によってこの弱点を構造的に解消しました。

特に、日本語のリップシンクが公式にサポートされている点は、日本のVTuber運営企業やアニメ制作会社にとって計り知れないメリットです。

テキストでセリフを入力するだけで、感情のこもった日本語音声と、それに完璧に連動した口の動きが手に入ります。声優の収録や、アニメーターによる口パクの作画作業(リップシンク調整)を大幅に削減できる可能性があります。

3. 多言語展開によるグローバル市場への即時アクセス

日本の優れたコンテンツを海外に輸出する際、吹き替え制作には多大な時間とコストがかかります。

HappyHorseを使えば、元の映像の雰囲気を一切損なうことなく、瞬時に多言語版を作成できます。

例えば、日本の企業が制作した新商品のプロモーション動画を、HappyHorseに入力します。そして「この動画の登場人物に、同じ内容をフランス語とドイツ語で喋らせて」と指示するだけです。

AIは元の人物の声を維持したまま、流暢な外国語を生成し、口の動きもその言語に合わせて再生成します。

これまで資金力のある大企業しかできなかった多言語グローバル展開が、中小企業や個人のクリエイターでも容易に行えるようになるのです。

慎重に見るべきリスクと注意点

ただし、制作現場への導入にあたっては、慎重に見るべき点もあります。

現在、HappyHorseはまだ「未公開のベータテスト段階」です。ベンチマークサイトで高いスコアを出したことと、実際の業務システムに組み込んで安定して使えることは別問題です。

連続して大量の動画を生成した際にエラーが起きないか、思い通りの構図をどこまで細かく制御できるかなど、実務レベルでの検証はこれから本格化します。

また、生成された動画の著作権の扱いについても、Alibabaの正式なライセンス条件が発表されるまでは注意が必要です。

今後の公開スケジュールと安全な利用方法

「HappyHorseをすぐにでも使ってみたい!」と思った方も多いでしょう。しかし、ここで実務上もっとも注意しなければならない重要なポイントがあります。

結論から言うと、現在ネット上に出回っている「HappyHorseが使える」と謳うサイトは、ほぼすべて偽物です。公式の公開スケジュールを正しく理解し、詐欺に引っかからないようにする必要があります。

公式アカウントの強い警告

HappyHorseの話題性が爆発的に高まったことで、悪意のある人々が動き出しました。「HappyHorse公式サイト」を名乗る偽のウェブサイトや、不正なアプリが多数登場しているのです。

IT系ニュースサイトのGIGAZINEも、ランキング公開後に詐称サイトが乱立していると報じています。

これに対し、Alibabaの公式X(旧Twitter)アカウント(@HappyHorseATH)は、以下のように明確な注意喚起を行っています。

「HappyHorseはまだ stable(厩舎)の中にいます。公式サイトは現時点で存在せず、現在ネット上に出回っているものは我々のものではありません。準備ができたら必ず公式からお知らせします」

つまり、現時点で一般ユーザーが自由に使える公式サイトやアプリは「存在しない」ということです。クレジットカード情報を入力させたり、怪しいソフトをダウンロードさせたりするサイトには絶対に近づかないでください。

現時点で「本物」を体験する唯一のルート

では、現時点で本物のHappyHorseの実力を確認する方法はないのでしょうか。

唯一の正規ルートは、先ほど紹介した評価サイト「Artificial Analysis Video Arena」に参加することです。

このサイトでは、ランダムに2つのAIモデルが出力した動画が並びます。自分が「HappyHorseを使って指定した動画を作る」ことはできませんが、ブラインド投票を繰り返す中で、HappyHorseが生成した本物の高品質な動画を視聴することは可能です。

モデルの実力を肌で感じたい方は、このアリーナでの投票に参加してみることをお勧めします。

待望のAPI公開は4月30日予定

気になる正式公開のスケジュールですが、AlibabaのATH広報は「近いうちに外部開発者向けのAPIアクセスを提供する」と公式にコメントしています。

現在の情報では、2026年4月30日にAPIがローンチされる予定です。

API(Application Programming Interface)が公開されれば、世界中のエンジニアが自分のアプリやサービスにHappyHorseの機能を組み込むことができるようになります。

さらに、生成系メディアプラットフォームの「fal」というサービスが、「HappyHorseは4月下旬にfalに登場予定」とアナウンスしています。

falのようなサードパーティのプロバイダを経由することで、一般のクリエイターも手軽にHappyHorseの画像・動画生成機能を使い始めることができるようになる見込みです。

オープンソース化の噂の真相

AIコミュニティで最も関心を集めているのが、「HappyHorseはオープンソース化されるのか?」という疑問です。

一部のコミュニティサイトでは、「フル・オープンソース化される」「商用利用可能なライセンスで無料公開される」といった期待に満ちた記述が見られます。

もし本当に150億パラメータの重みファイル(AIの脳のデータそのもの)が無料で公開されれば、世界中の研究者が自分のパソコンでHappyHorseを動かし、さらに改良を加えることができます。AI業界に計り知れない衝撃を与えるでしょう。

しかし、注意が必要です。Alibabaの公式リリースでは、オープンソース化について明確に確定した発表はまだありません。執筆時点(2026年4月17日)では、コードも、重みファイルも、ライセンス条件も一切公開されていません。

コミュニティの熱狂的な期待と、企業の慎重な姿勢にはまだ温度差があります。ビジネスで本格的に利用する計画を立てる場合は、公式のライセンス条件が確定するのを待つのが無難です。

まとめ:HappyHorseが切り拓く2026年の未来

いかがでしたでしょうか。謎の匿名デビューから世界1位の称号を奪い取るまで、HappyHorse-1.0が巻き起こした旋風のすべてを解説してきました。

最後に、本記事の重要なポイントを3つにまとめます。

- ワンパス同時生成の革命HappyHorseは、テキストや画像から「動画と音声(リップシンク込み)」を1回の処理で同時に作り出す画期的な技術(統合単一ストリーム構造)を持っています。これにより、エラーのない自然な映像を、H100 1枚で38秒という圧倒的なスピードで生成できます。

- 圧倒的なベンチマークスコアブラインドテストにおいて、史上最大の得点差で競合モデル(Seedance 2.0やKling 3.0)を打ち破りました。特に画像からの動画生成(I2V)と、日本語を含む7カ国語のネイティブなリップシンクにおいて、他を寄せ付けない実力を誇ります。

- Alibabaの「本気」の象徴天才エンジニアZhang Di氏の引き抜きや、社内の並行開発体制など、HappyHorseはAlibabaが「AI全振り」で動画生成市場の主導権を取りに来たことの強力な宣言です。

動画生成AIの勢力図はどう変わるのか

HappyHorseは、単なる一つの優れたAIモデルではありません。これは「Alibabaによる動画AI市場の覇権宣言」です。

OpenAIのSoraが撤退し、ByteDanceのSeedance 2.0が著作権問題で足踏みをする中、生じた「王座の空白」。Alibabaは、最も完璧なタイミングで、最も強力なモデルを投下しました。

次の大きな分水嶺は、4月30日に予定されているAPI公開と、その後のライセンス条件の発表です。

AlibabaがHappyHorseの技術をオープンに広く提供する道を選ぶのか、それとも自社のクラウドサービスに囲い込む道を選ぶのか。その選択によって、2026年の動画生成AIの勢力図は決定的に変わるでしょう。

私たちクリエイターやビジネスパーソンは、この技術の進化をただ眺めるだけでなく、どうやって自分の仕事に組み込んでいくかを考えるフェーズに来ています。

言葉の壁を越え、誰もが頭の中のイメージを瞬時に高品質な映像と音声に変換できる時代。HappyHorseが切り拓く「幸せな未来」は、すぐそこまで来ています。

まずは4月30日の公式発表を待ちつつ、今後の動向から目を離さないようにしましょう。情報収集の際は、必ず公式アカウント(@HappyHorseATH)を確認し、偽情報に惑わされないようご注意ください。